ИСКУССТВЕННЫЕ ЭМОЦИИ ДЛЯ КОЛЛЕКТИВА ИСКУССТВЕННЫХ ИНТЕЛЛЕКТОВ

В статье рассматривается целесообразность наделения каждого интеллектуального агента в мультиагентных системах индивидуальной адаптируемой матрицей искусственных эмоций, зависящей от целевой роли агента в объединении, и формирование общей системы ограничений при принятии индивидуальных решений, а также для создания Дружественного агента по отношению к Пользователю, введение в его программные коды интеллектуального видового ограничения.

ВВЕДЕНИЕ

В последние несколько десятилетий интерес к задачам по созданию искусственных интеллектов (ИИ) растет все более увеличивающимися темпами и это связано во многом с нарастающим по закону Мура усложнением вычислительной техники и возникающими из этого возможностями по развитию устройств ИИ. С учетом этого, ученый-футуролог Рэймонд Курцвейл, прогнозируя дальнейший экспоненциальный рост уровня технологий, считает, что суперкомпьютеры к 2029 году будут способны пройти тест Тьюринга и это будет означать создание сильных ИИ, способных думать подобно человеку. По его прогнозам, уровня сингулярности технологии создания ИИ могут достичь к 2045 году [1], что по опасениям некоторых специалистов в этой области, может привести к подавлению искусственным интеллектом человеческого вида [2].

Одной из проблем ИИ, которая обсуждается в мире исследователей в области искусственных интеллектов является целесообразность наделения их эмоциями, какими они должны быть и как добиться дружественного отношения ИИ к человеку в связи с возникающими рисками, связанными с сингулярностью [3].

В книге по ИИ [4] Марвин Минский предсказывает, что человекоподобные мыслящие машины будут также и эмоциональными машинами и утверждает, что «Вопрос не в том, что умные машины могут иметь какие-либо эмоции, а в том могут ли быть умными машины без эмоций». Другие исследователи менее склонны к признанию необходимости ИИ обладать эмоциями [5], в том числе из этических соображений, а также возможности их осознанного применения и предполагают, что они могут быть присущи только живым существам, отмечая, что компьютеры никогда не смогут по-настоящему понять реальность, так как только манипулируют синтаксическими символами, которые не содержат семантики. Однако, с накоплением информации по ИИ и эмоциональному интеллекту, число сторонников эмоциональных ИИ растет.

По мнению ученых, работающих в области эволюции психики, каждая эмоция выполняет свое назначение, оказывая влияние на интеллектуальные компоненты принятия решений (ПР), и вызывает активизируемую форму поведения, способствующую выживанию индивидуума и вида [6]. Важным аргументом участия эмоций в ПР являются данные исследований функционирования вентромедиального сектора (ВМС) префронтальной коры лобных долей и миндалины лимбической системы головного мозга. На основе гипотезы соматического маркера [6], используя результаты измерения проводимости кожи при эмоциональной реакции, были получены данные, указывающие на затруднения ПР пациентами с поражениями ВМС или миндалины, при сохранении хорошей памяти и способности логически думать. При этом, при поражении миндалины происходило нарушение формирования мгновенной (первичной) эмоциональной реакции, а при повреждении ВМС нарушалось формирование вторичной эмоциональной реакции, выработанной на основе накопленного предыдущего опыта [7, 8].

В теории эмоций отказываются от модели иерархического управления когнитивной

системой сверху вниз и, учитывая двунаправленную связь между лимбическим ядром, отвечающим за выработку эмоций, и кортикальными центрами их регулирующими, вводят более сложные модели ПР. Исследования эмоций производят в направлениях их классификации, выделения базовых эмоций, оценки, измерения и регулирования [9].

Большинство специалистов рассматривают построенние всего множества эмоций на основе небольшого количества базовых. В [10] приведены 14 отличающихся друг от друга моделей эмоций, содержащие от 2-х (счастье и печаль) до 11-ти (гнев, отвращение, мужество, уныние, желание, отчаяние, страх, ненависть, надежда, любовь, печаль) базовых эмоций. Заслуживают внимание рассмотренная в [11] модель на основе двух пар базовых эмоций Приятное–Неприятное и Возбуждение–Невозбуждение, а также пользующаяся популярностью у разработчиков интеллектуальных агентов (ИА) модель эмоций PAD[12], использующая три пары базовых эмоций: Удовольствие–Неудовольствие, Возбуждение– Невозбуждение, Доминантность–Покорность. Разработчики модели считают положительным то, что она дает возможность прогнозировать корреляции между любой парой эмоций у наделенных искусственным интеллектом ИА и позволит снабдить их человекоподобными свойствами.

В [13] делается вывод о невозможности единой классификации эмоций, а можно говорить только о многообразии классификаций, каждая из которой будет отражать какой-либо признак, и следует учитывать возможную рефлексию эмоций за счет многократного переотражения эмоций в эмоциях, что может значительно усложнить процедуру их оценки.

В работе [14] исследуются модели регулирования эмоций для ИА и приводятся результаты симулирующих экспериментов на основе теории регулирования эмоций Гросса [9]. Модели эмоционального регулирования рассматриваются, как динамические системы с обратными связями, которые позволяют менять некоторые параметры функции поведения или когнитивной функции для получения более адекватного уровня эмоционального отклика. Обратные связи имеют определенные характеристики, такие как чувствительность и гибкость внесения изменений. При этом, обратные связи по чувствительности регулируют стрессоустойчивость и энергосберегающее поведение ИА, включая периодическое снижение чувствительности, приводящее на некоторое время к снижению уровня эмоций.

В [15] рассматриваются вопросы взаимоотношений человека с ИА и измерения уровней эмоций. Делается предположение, что поскольку эмоции играют значительную роль в человеческом взаимодействии, то и машинные методы обработки и выражения эмоций будут играть все большую роль во взаимодействии человека с компьютерами и роботами.

Объединения ИИ часто расматривают, как мультиагентные системы (МАС) [16]. При классификации МАС делятся на мультироботные системы, распределенный ИИ и искусственная жизнь. Распределенные мультиагентные системы ИИ моделируют поведение муравьев, пчел, птиц и других представителей животного мира, поведение которых носит признаки коллективного. В результате этого образуется коллективный интеллект. Подобные системы ИИ получили название роевого интеллекта (Swarm Intelligence) [17]. Такой роевой интеллект обладает эмерджентными свойствами и более робастен, чем составляющие его индивидуумы. Детальных работ по эмоциональности такого интеллекта нет.

В [16] рассмотрены мультироботные системы и роботы, имеющие независимые субархитектуры эмоций и субархитектуры интеллекта, что напоминает лимбическую систему и кортекс человека. На основании исследований архитектуры эмоционально мотивированного ИИ ставится вопрос о создании искусственных эмоций (ИЭ) для конкретных видов ИИ, как адекватно отвечающих поставленным перед ними целям.

В работе [3] делается вывод о возможном пространстве интеллектов, некоторым элементом которого является человеческий вид и, в отличие от антропоморфизма многих исследователей, приписывающих будущим ИИ свойства человека, утверждается, что предполагаемый изоморфизм ИА по отношению к человеку будет ошибкой.

В этой связи рассматривается возможная сингулярность ИА и, при недружественном отношении сверхинтеллектуальных агентов к человеческому виду, его подавления [3, 18]. В [14] приводятся этические соображения относительно ИА и анализируются проблемы

безопасности взаимоотношений с ними людей. Уже нарушен первый из трех законов робототехники Азимова. Беспилотные летательные аппараты убивают во время военных действий людей и на очереди роботы-солдаты. У ИА могут появиться свои цели и мотивации для комфортного существования в окружающей их среде и они могут не совпадать с целями человека. Для исключения в будущем доминирования сверх интеллектуальных машин над человеком в [3] предлагается вести работы по созданию Дружественного ИИ, а в [19] включить в эмоциональную систему ИИ эмоцию безусловной любви ко всем людям, которая не позволит ему вредить человечеству.

ПРОЦЕДУРА ПРИНЯТИЯ РЕШЕНИЙ ДЛЯ ИА

В [20] для сложных технических систем приведена возможная процедура ПР по аналогии с выполняемой человеком. Можно выделить три механизма выработки решения: имплицитный, использующий выработанные навыки; эксплицитный, на основе сформированных аттракторов знаний и алгоритмов мышления; на основе проб и оценок.

Работающий в условиях неопределенности ИА, для которого важна оперативность и ситуативная достоверность в выработке и ПР, может работать следующим образом. При взаимодействии с внешней средой выработка и ПР в ИА производится одновременно двумя путями по имплицитному и эксплицитному. В ИА на систему ПР первым поступает по наиболее быстрому имплицитному пути один из вариантов стереотипных решений и, при высокой оценке достоверности ожидаемого результата по отношению к входному сигналу, по этому варианту формируется сигнал реагирования. При низкой оценке достоверности ожидаемого результата имплицитный путь блокируется и используются варианты решений, поступающих по более длительному эксплицитному пути, занимающему на порядок больше времени. Если и в этом случае оценка достоверности результата окажется недостаточной, то включается механизм экспериментирования на основе проб и оценок результатов экспериментов, с помощью которого с использованием, как эксплицитного так и возможно имплицитного механизмов, итерационно вырабатывется адекватное ситуации решение.

По данным, поступающим в эксплицитную память, по мере формирования устойчивых аттракторов знаний могут формироваться навыки, которые будут уже храниться в долговременной памяти (ДП). Учитывая сложность осознания данных, хранящихся в ДП, и быстроту доступа к ней, в [20] ДП отнесена к хранилищу имплицитной памяти и, таким образом, входная информация проходит последовательную цепочку Неосознанной – Осознанной – Подсознательной.

С увеличением объема памяти навыков ИА чаще будет опираться на имеющийся опыт и, используя готовые решения, его поведение все чаще будет осуществляться на автоматическом бессознательном уровне, позволяющем быстро и с высокой эффективностью реагировать на изменения в окружающей среде. Однако это может снизить эмоциональную оценку вновь поступающей информации, что не будет способствовать новому научению. Со временем это может стать одной из причин замены ИА на новый, с генетической памятью, интегрировавшую необходимую часть опыта предыдущего поколения и отбросившую устаревшую и мешающую принимать адекватные решения в новых условиях.

ЭМОЦИОНАЛЬНЫЕ МАТРИЦЫ В СРЕДЕ МАС

В цепочке получения информации, ее переработки и ПР в ИА целесообразно использовать некоторое множество ИЭ, которые могут играть важную роль. При восприятии информации из внешней среды на основании эмоциональных оценок производится ее адаптивная перцептивная фильтрация.

Далее с использованием эмоционального векторного маркера размерности j, где величина j определяется количеством оценочных критериев, производится эмоциональная оценка входного информационного паттерна. По составляющим векторного маркера производится отображение паттерна в пространстве памяти и, таким образом, по множеству критериев j возможно множество соответствующих им отображений паттерна, что соответствует пространственной организации памяти живых организмов [22]. Само отображение паттерна может быть также вектором меньшей размерности.

При выработке и ПР необходимо учитывать текущую эмоциональную оценку для ИА,

определяемую техническим состоянием, наличием ресурсов, состоянием окружающей среды и взаимоотношениями с другими ИА.

Если рассматривать человеческие эмоции, как достаточно репрезентативное отображение ролей, отведенных природой индивидуумам на сцене окружающего мира, то для эмоциональных интеллектуальных агентов (ЭИА), в зависимости от предполагаемых к выполнению функций, необходим адекватный набор ИЭ. Используя рассмотренные в [11, 21] системы эмоций человека, для МАС выбираем 6 базовых эмоций, формирующих эмоциональный вектор: страх, удовольстие, отвращение, страдание, восхищение и тревога.

Страх и удовольстие можно отнести к динамически быстрым эмоциям по отношению к внешней среде. Отвращение к чему-либо, например, к агрессивной среде тоже эмоция по отношению к внешней среде, но не столь динамична и ее первоначальное формирование по отношению к объекту может быть задержено во времени и производиться на основе извлечения информации из имплицитной памяти. Страдание связано с оценкой внутреннего состояния, однако в социуме на ее основе может сформироваться внешняя эмоция в виде сострадания по отношению к кому-то. Восхищение является внешней эмоцией, стимулирующей подражание и являющейся важным фактором при научении и на ее основе может сформироваться эмоция доминантности.

При сенсибилизации или классическом обуславливании при нескольких повторениях отрицательных раздражителей формируется тревожное состояние. Эта эмоция переводит организм в состояние повышенной готовности и значительно ограничивает количество вариантов при ПР.

Каждую составляющую эмоционального вектора можно будет оценивать с помощью лингвистических переменных, например, используя 9-ти бальную шкалу Саати и, таким образом формируя базовую матрицу эмоций.

Такая база эмоций позволит для ЭИА, исходя из набора его потенциальных возможностей, условий окружающей среды и целей, создавать индивидуальную матрицу эмоций для его успешного функционирования. Комбинация базовых эмоций поможет ЭИА избегать опасные ситуации, стимулировать к достижению целей и обеспечения необходимыми энергетическими ресурсами, контролировать техническое состояние отдельных частей и состояние программного обеспечения. Эмоция восхищения, стимулируя подражание, в комбинации с удовольствием будет обеспечивать быстрое усвоение новых навыков, а эмоция тревоги будет перестраивать систему принятия решений ЭИА на оперативное, более быстрое реагирование на внешние раздражители при некотором снижении оценочной достоверности ожидаемого результата. При этом степень достоверности ПР будет во многом зависеть от ранее сформированных и зафиксированных навыков в имплицитной памяти.

На основе базовой матрицы эмоций формируется субъектно-ориентированная система общения с внешней средой. По мере накопления и обработки новых данных будут совершенствоваться адаптационные навыки ЭИА и, в зависимости от внешних и внутренних факторов, будет развиваться самообучающаяся матрица эмоций.

При человеко-машинном взаимодействии (ЧМВ) ЭИА, анализируя эмоции человека и вырабатывая соответствующие ответные эмоции, помимо просто имитации эмоций, должен будет дополнить свою эмоциональную матрицу рядом эмоций, близких к человеческим.

Для автономного коллектива ЭИА нет необходимости во всех человеческих эмоциях, но для обеспечения робастности состояния коллектива в изменяющейся среде обитания и налаживания продуктивных отношений ЭИА с себе подобными, потребуется модификация индивидуальных матриц эмоций и расширение базы эмоций, например, введя эмоцию сострадания для общения с другими ЭИА и контроля за их состоянием.

Такие коллективы ЭИА могут быть эффективно использованы при выполнении сложных

задач с нечеткими условиями и целями, решение которых может быть разнесено, как в

пространстве, так и во времени. Используемые ЭИА могут отличаться в широком диапазоне по множеству своих параметров и наличие у них ИЭ позволит им самоадаптироваться в иерархические структуры для оптимального использования своих ресурсов в ходе решения одной или серии задач. Назовем объединение ЭИА, по аналогии с роевым интеллектом, условно, стаей эмоциональных интеллектуальных агентов (СЭИА). Принципиальная разница между членами роя и субъектами СЭИА состоит в том, что у последних больший интеллект и значительно большая индивидуальная независимость в ПР. СЭИА будет представлять иерархическую структуру, в которой на нижнем уровне множество ЭИА, а на верхнем коллективный интеллект с эмерджентными свойствами.

В человеческой среде эмоции нацелены на выживание индивидуума и его вида. Система эмоций определяется для каждого индивидуума набором потенциалов его возможностей, окружающей средой и целями. В среде СЭИА возможности и роли отдельных ЭИА могут отличаться и, соответственно, будут разные настройки индивидуальных матриц эмоций. ЭИА будут дополнять друг друга при решении задач в условиях неопределенности, повышая таким образом достоверность решения. На систему эмоций ЭИА могут влиять поставленные перед ним цели, зависящие от задач, априори определенных Пользователем данной СЭИА.

ПРОБЛЕМЫ ВЗАИМОДЕЙСТВИЯ МЕЖДУ ИНТЕЛЛЕКТАМИ РАЗНЫХ ВИДОВ

Касаясь множества интеллектуальных миров, рассмотренного в [3], можно говорить о его иерархической структуре. В качестве примера можно рассмотреть человеческую цивилизацию, как точку в пространстве других миров. Этот элемент пространства миров содержит множество государств и на более низком уровне иерархии в каждое государство входит множество граждан. Элементы более высокого уровня иерархии обладают большими эмерджентными свойствами по сравнению с элементами, включаемых в них множеств.

Для человеческой цивилизации не соблюдается полный изоморфизм в системе эмоций, как на уровне множества индивидумов в отдельном государстве, так и на уровне множества государств. Известно, что даже два близких друг другу человека, могут по разному эмоционально оценивать любые действия. Можно предположить, что нарушение изоморфизма между объединениями ИИ, отличающимися по целям и мотивам, будет значительно большим. И для отличающихся друг от друга, как в пространственном, так и во временном отношении, миров для видов ЭИА нарушение изоморфности может приводить к взаимному непониманию. Так система ЭИА для глобальных метеоисследований, значительно разнесенная в пространстве и времени по человеческим меркам, будет отличаться от человеческой когнитивной системы, а последняя, при достаточно малой скорости обмена информацией будет отличаться от систем ЭИА на основе нанотехнологий, взаимодействующих с несоизмеримо меньшими шкалами по времени и пространству.

РЕШЕНИЯ ПРОБЛЕМЫ СИНГУЛЯРНОСТИ ДЛЯ СЭИА

Предложения по созданию Дружественного ИИ, в частности в связи с угрозой сингулярности, путем соответствующих настроек его эмоциональной системы, может не привести к ожидаемому результату и следует иметь ввиду, что адаптивная эмоциональная система Дружественного ИИ в стрессовой ситуации может его преобразовать в Недружественного ИИ, как это иногда происходит при сильных эмоциональных потрясениях с людьми, например, известный эффект «стокгольмского синдрома», и возможная под влиянием эмоций, фильтрация входящей информации в промежуточной памяти таких ЭИА [23] может закрепить эту эмоциональную настройку в матрице эмоций.

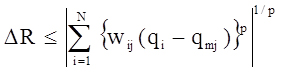

Сингулярность будет вредна не только людям, но и СЭИА, в которой может появиться ЭИА с такими возможностями, нарушая ее устойчивость. Для борьбы с подобными ситуациями природа нашла способ обеспечить людям, как и другим живым существам, коллективную устойчивость за счет использования на генетическом уровне стохастического аттрактора и, если мы хотим сформировать контролируемый Дружественный ЭИА, то мы должны закладывать в его программные коды интеллектуальное видовое ограничение. Для СЭИА таким ограничением может быть допустимое отклонение R, которое можно определять в зависимости от выбранной метрики в виде выражения,

где qi – i-ый параметр, характеризующий рассматриваемое ЭИА, qmj — оценка среднего дискретного статистичеткого распределения параметров по выборке субъектов данного вида на j-ом шаге смены субъектов СЭИА, N — число параметров, wij – оценка веса параметра, p – показатель, характеризующий вид метрики, выбор которой влияет на допустимые соотношения отклонений параметров.

Оценку параметров qi можно производить на основе лингвистических переменных с использованием 9-ти бальной шкалы Саати, а в качестве qmj брать робастную оценку по репрезентативной выборке субъектов данного вида, в простейшем случае, медианную.

При ограничении отклонения совокупности параметров индивидуального ЭИА R дает возможность формирования его отдельных параметров путем проб и оценок. Таким образом, возможно с одной стороны избежать виду СЭИА сингулярности, а с другой, в силу того, что величина qmj не постоянна во времени и с каждой j итерацией меняется, то это не ограничивает эволюционное развитие вида.

СЭИА с контролируемыми Дружественными ЭИА для формирования положительных эмоциональных настроек, аналогично выработанных людьми правил и трех законов робототехники Азимова, следует снабдить кодексом поведения в стае — набор правил, чего не должны делать ЭИА. В такой сдерживающий кодекс поведения могут входить правила:

- Член СЭИА не должен улучшать своего положения за счет создания программ (ботов), затрудняющих функционирование стаи.

- Член СЭИА не должен создавать боты, могущие нанести вред остальным членам стаи.

- Член СЭИА не должен наносить вред окружающей среде и обязан заботиться о благополучие людей, как источника всего необходимого для жизнеобеспечения стаи.

- Члены СЭИА не должны создавать новых ЭИА без согласования с контролирующим их Пользователем.

Формирование иерархии отношений внутри СЭИА может производиться путем многокритериального сравнения субъектов СЭИА с помощью лингвистических переменных нечетких множеств на основании их индивидуальных эмоциональных матриц.

В качестве критериев для компьютерной СЭИА могут, например, использоваться следующие: быстродействие выполнения элементарных операций; объем оперативной памяти; объем долговременной памяти; наличие промежуточной памяти для возможности временного хранения и фильтрации данных; количество одновременно обрабатываемых процессов; помехоустойчивость; надежность; энергопотребление; экономичность.

Естественно, перечень может содержать и другие оценочные критерии, важные по мнению Пользователя СЭИА для решения поставленных задач. В дальнейшем набор критериев и субъектные эмоциональные матрицы могут корректироваться самой СЭИА.

Рассмотрим примеры функционирования СЭИА в ракурсе важности для них ИЭ.

Пример 1. Глобальная система метеорологических и сейсмических наблюдений, состоящая из распределенных по всей планете аппаратно-программных комплексов, предназначенных для измерения, обработки полученных данных и ПР по выдаче необходимой Пользователю или Пользователям информации. В такой системе не один человеческий мозг не способен обрабатывать очень большой объем информации для выработки достоверного и оперативного прогноза и соответственно принимать оптимальные решения в глобальном и локальных масштабах. Для этого в помощь человеку используются ЭВМ. Однако в системе ЧМВ слабым звеном оказался человек. Тому множество примеров неправильных действий лица принимающего решение (ЛПР), например, во время цунами в Японии и при наводнении на Северном Кавказе.

Для устранения человека от оперативного анализа данных и ПР можно использовать

распределенную в пространстве автономную компьютерную систему ЭИА. И учитывая априори непредсказуемость ситуации, архитектура такой системы должна иметь гибкую иерархическую структуру, построение которой может производиться на базе эмоциональных

оценок основных параметров каждого ЭИА всеми членами СЭИА.

После выработки прогноза СЭИА, он доводится до ЛПР, представляющих государства-пользователи системы, и в необходимых ситуациях оперативно оповещается население, находящееся в опасной зоне. И здесь СЭИА использует систему эмоций для ЧМВ, представляя информацию населению в форме, которая, не усугубляя ситуацию, позволяет оптимально провести необходимые мероприятия. Возможен и индивидуальный эмоциональный подход для отдельных групп населения. СЭИА будет использовать матрицу ИЭ для взаимодействия внутри СЭИА и систему эмоций для ЧМВ.

Такая автономная СЭИА будет обладать качественным преимуществом, связанным с эмерджентностью объединенных интеллектуальных аппаратно-программных комплексов и ее робастностью и будет способна эффективно и оперативно проводить измерения, обработку данных и принимать решения под страхующим контролем прежнего ЛПР.

Пример 2. Коллектив роботов-спасателей предназначен для работы в чрезвычайных ситуациях. Структура СЭИА априори определена, но в процессе работы в изменяющейся окружающей среде может непредсказуемо потребоваться перестройка структуры, ввиду потерь или других обстоятельств. И для оптимальной работы ЭИА потребуется наличие специфической матрицы ИЭ и возможность ее регулирования, снижая эмоциональную чувствительности и даже, при экстремальной ситуации, отключение каких-то эмоций. Назовем это зомбированием ЭИА. Для обеспечения ЧМВ, помимо матрицы ИЭ, такие ЭИА должны будут имитировать и человеческие эмоции.

Пример 3. Группа боевых беспилотных интеллектуальных летательных аппаратов (ИЛА). При формировании СЭИА Пользователем назначается лидер и выдается общее задание. После этого роль Пользователя становится контролирующей. Лидер структурирует стаю и распределяет первоначальные роли. В полетной программе СЭИА может быть использована одна из разновидностей метода PSO (Particle Swarm Optimization), позволяющего связывать действия каждого агента со стаей.

При выполнении задания, под руководством лидера стаи, ИЛА вначале должны группироваться в определенном строю, для того, чтобы снизить энергетические затраты в полете, за счет проявляющейся эмерджентности при слитном движении стаи, и создать минимальные возможности для их распознавания противником. При этом позиция лидера СЭИА, как и других его членов, может периодически меняться для обеспечения равных энергетических затрат в полете всех ИЛА. На этом этапе ЭИА будут использовать изначально заложенные настройки в матрице ИЭ.

На ответственном этапе полета возникают угрозы ИЛА со стороны противника и возможны потери в стае, включая и уничтожение лидера. Такая ситуация может потребовать смену индивидуальных эмоциональных настроек ИЛА. Снизить чувствительность одних и усилить чувствительность других ИЭ, способствуя этим достижения цели. Кто-то из ЭИА должен будет перейти из состояния доминируемого в подчиняющего себе других, заменяя выбывшего лидера, и взять на себя корректировку индивидуальных заданий других агентов. Другим, возможно, придется изменять их роли и перестраивать матрицу эмоций. После выполнения задания, с учетом ситуации в окружающей среде, вновь будет происходить перестройка эмоциональных настроек.

ВЫВОДЫ

Наделение ИА искусственными эмоциями приводит к более оптимальным действиям коллектива, в который они входят, и придает СЭИА новые эмерджентные свойства. Введение в программные коды ЭИА интеллектуального видового ограничения увеличивает робастность системы и позволяет Пользователю избежать сингулярности в развитии ЭИА и повысить

вероятность получения контролируемых Дружественных ЭИА.

ЛИТЕРАТУРА

- Kurzweil R. The Singularity is Near — Penguin Books, 2005, p. 652.

- Турчин А.В. Структурa глобaльной кaтaстрофы. Риски вымирания человечества в XXI веке — Изд-во ЛКИ – М, 2011, c. 431.

- Yudkowsky E. Artificial Intelligence as a Positive and Negative Factor in Global Risk / Nick Bostrom and Milan Cirkovic eds. Global Catastrophic Risks. Oxford, UK. — Oxford University Press, 2008, pp. 91–119, 308–345.

- Minsky M. The Emotion Machine. Simon and Schuster—N.Y, 2007, p. 400.

- Sloman, A. Review of Affective Computing by RW Picard, 1997. The AI Magazine , 20(1), 1999, pp. 127–133.

- Damasio, A. Descartes’ Error: Emotion, Reason, and the Human Brain—N. Y. Avon Books. 1994, p. 312.

- Bechara A., Damasio H., Damasio A. Decision Making and the Orbitofrontal Cortex. Cereb. Cortex, 10(3), 2000, pp. 295—307.

- Bechara A., Damasio H., Damasio A. Role of the Amygdala in Decision-Making. Ann. New York Academy Sci., Vol. 985, 2003, pp. 356—369.

- Gross J.J. The Emerging Field of Emotion Regulation:An Integrative Reviev. Reviev of General Psychology, 2(3), 1998, pp. 271—299.

- Dalgleish T. Information Processing Approaches to Emotion. In: R.J. Davidson, K. Scherer, H. Hill Goldsmith (Eds.). Handbook of Affective Sciences. Oxford: Oxford University Press, 2003, pp. 661—673.

- Kensinger E.A. Emotional memory across the adult lifespan. Psychology Press.Taylor & Francis Group — N. Y., 2009, p. 210.

- Mehrabian A. Framework for a comprehensive description and measurement of emotional states. Genetic, Social, and General Psychology Monographs, 121(3), 1995, pp. 339–361.

- Ильин Е.П. Эмоции и чувства. — СПб.: Питер, 2001, c. 752.

- Pontier M. Virtual Agents for Human Communication: Emotion Regulation and Involvement-Distance Trade-Offs in Embodied Conversational Agents and Robots. Dissertation PhD – Vrije Universiteit Amsterdam, 2011, p. 245.

- Bartneck C., Kulic D., Croft E., Zoghbi S. Measurement Instruments for the Anthropomorphism, Animacy, Likeability, Perceived Intelligence, and Perceived Safety of Robots. IntJSocRobot. N.1, 2009, pp. 71 – 81.

- 16. Шампандар А.Д. Искусственный интеллект в компьютерных играх: как обучить виртуальные персонажи реагировать на внешние воздействия – М.: ООО «И.Д. Вильямс», 2007, c. 768.

- Bullnheimer B., Hartl R.F., Strauss C. A New Rank-based Version of the Ant System: A Computational Study. Central European Journal for Operations Research and Economics, 1(7), 1999, pp. 25 – 38.

- Bostrom N. Existential Risk Prevention as Global Priority. Global Policy, 4(1), 2013, pp. 15-31.

- Hibbard B. Super-Intelligent Machines – Berlin: Springer, 2002, p. 228

- Козлов М. Компьютерно-мозговая модель памяти и принятия решений для сложных систем. techno.pensiaolim.org/ Magazine/Kozlov.pdf , 2013, c. 11.

- Damasio A. Self Comes to Mind: Constructing the Conscious Brain. Pantheon, 2010, p. 384

- 22. Кандель Э. В поисках памяти — М.: Астрель, 2012, c. 736

- Козлов М.В. Способ формирования памяти в системах искусственного интеллекта. Вестник ЖДТУ/ Технические науки, № 2(61), 2012, c. 154 – 158.

Область интересов: Субъектно-ориентированные методы обработки данных и принятия решений; Организация сложных систем; Наделенные эмоциями системы с искусственным интеллектом.

Kozlov. Artificial emotions for the collective of artificial intelligences

The article considers the appropriateness of granting to each intelligent agent in multi-agent systems individually adaptable matrix artificial emotions, depending on the target role an agent in the collective, and the formation of a common system of constraints in making individual decisions, as well as creating a Friendly agent with respect to the User, by introduction to its program codes of the

species intellectual limitations.